Documentation Index

Fetch the complete documentation index at: https://docs.vidol.chat/llms.txt

Use this file to discover all available pages before exploring further.

Ollama 是一款强大的本地运行大型语言模型(LLM)的框架,支持多种语言模型,包括 Llama 2, Mistral 等。现在,LobeVidol已经支持与 Ollama 的集成,这意味着你可以在 LobeVidol中轻松使用 Ollama 提供的语言模型来增强你的应用。

本文档将指导你如何在 LobeVidol中使用 Ollama:

Ollama 是一款强大的本地运行大型语言模型(LLM)的框架,支持多种语言模型,包括 Llama 2, Mistral 等。现在,LobeVidol已经支持与 Ollama 的集成,这意味着你可以在 LobeVidol中轻松使用 Ollama 提供的语言模型来增强你的应用。

本文档将指导你如何在 LobeVidol中使用 Ollama:

在 macOS 下使用 Ollama

本地安装 Ollama

下载 Ollama for macOS 并解压、安装。

配置 Ollama 允许跨域访问

由于 Ollama 的默认参数配置,启动时设置了仅本地访问,所以跨域访问以及端口监听需要进行额外的环境变量设置 完成设置后,需要重启 Ollama 应用程序。

OLLAMA_ORIGINS。使用 launchctl 设置环境变量:在 windows 下使用 Ollama

OLLAMA_ORIGINS,值设为 * 。OK/应用保存后重启系统。Ollama。在 linux 下使用 Ollama

或者,你也可以参考 Linux 手动安装指南。

由于 Ollama 的默认参数配置,启动时设置了仅本地访问,所以跨域访问以及��口监听需要进行额外的环境变量设置

OLLAMA_ORIGINS。如果 Ollama 作为 systemd 服务运行,应该使用systemctl设置环境变量:使用 docker 部署使用 Ollama

docker run -d --gpus=all -v ollama:/root/.ollama -e OLLAMA_ORIGINS="*" -p 11434:11434 --name ollama ollama/ollama

安装 Ollama 模型

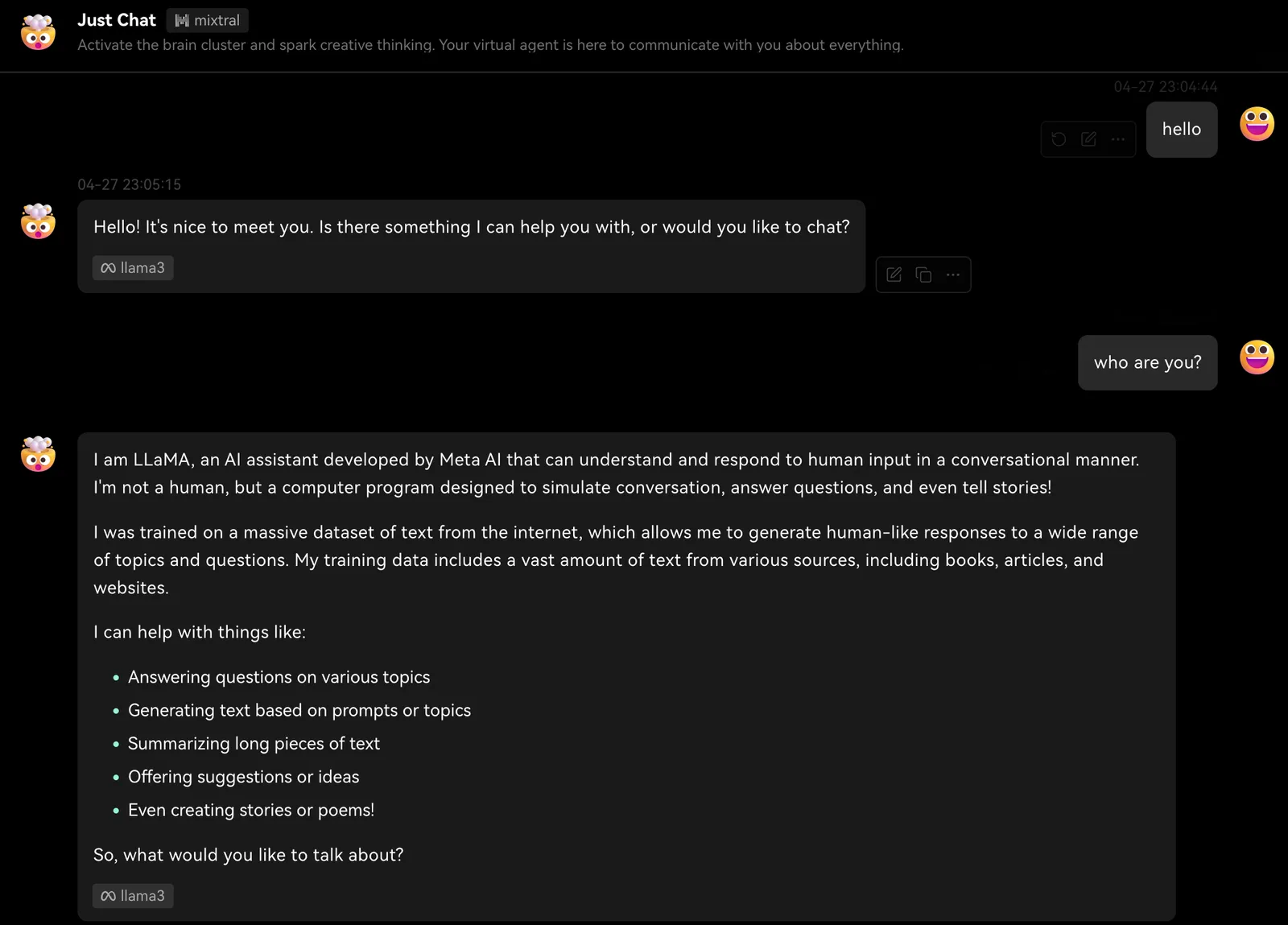

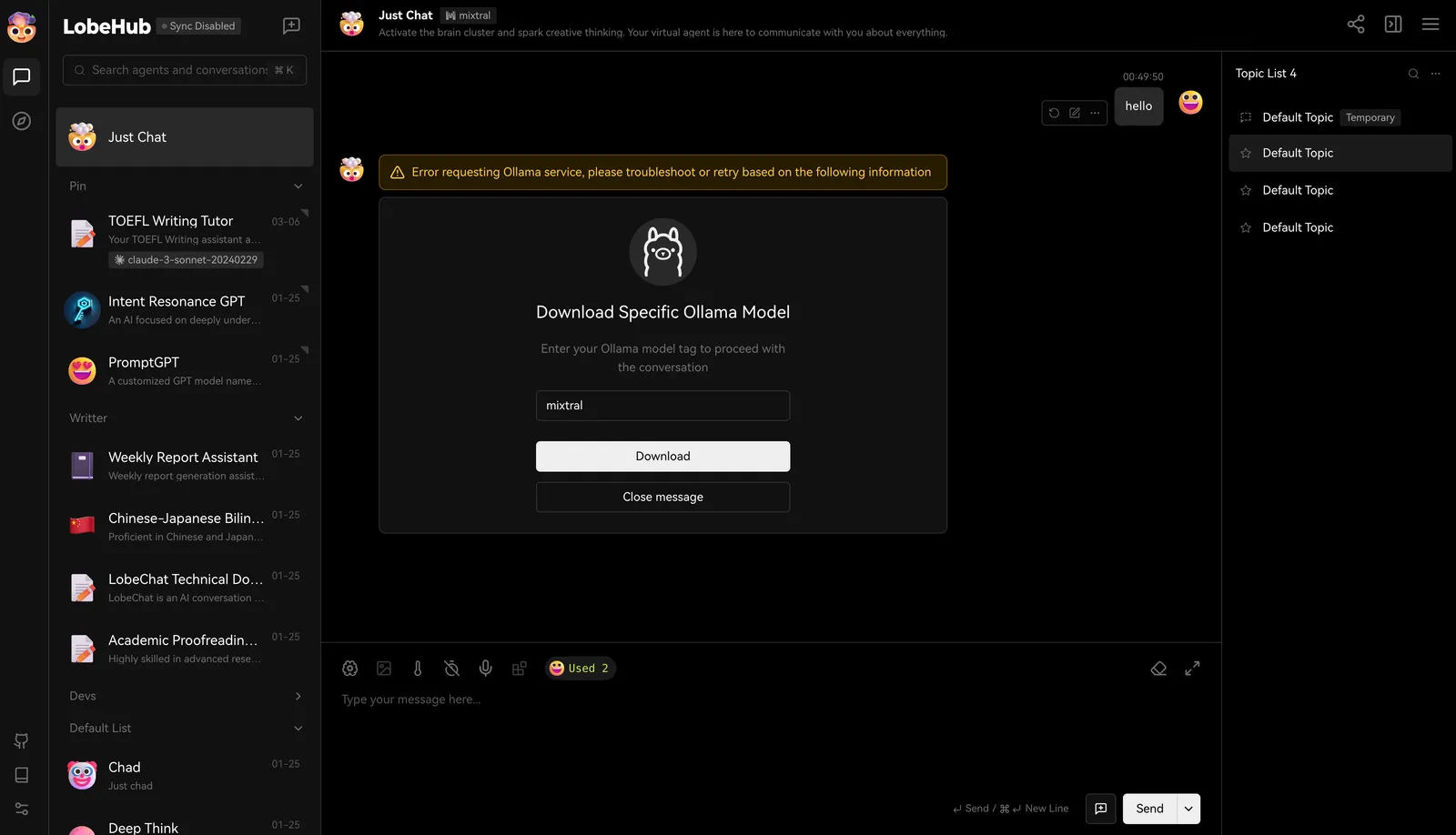

Ollama 支持多种模型,你可以在 Ollama Library 中查看可用的模型列表,并根据需求选择合适的模型。LobeVidol中安装

在 LobeVidol中,我们默认开启了一些常用的大语言模型,例如 llama3、 Gemma 、 Mistral 等。当你选中模型进行对话时,我们会提示你需要下载该模型。 下载完成后即可开始对话。

下载完成后即可开始对话。

用 Ollama 拉取模型到本地

当然,你也可以通过在终端执行以下命令安装模型,以 llama3 为例:自定义配置

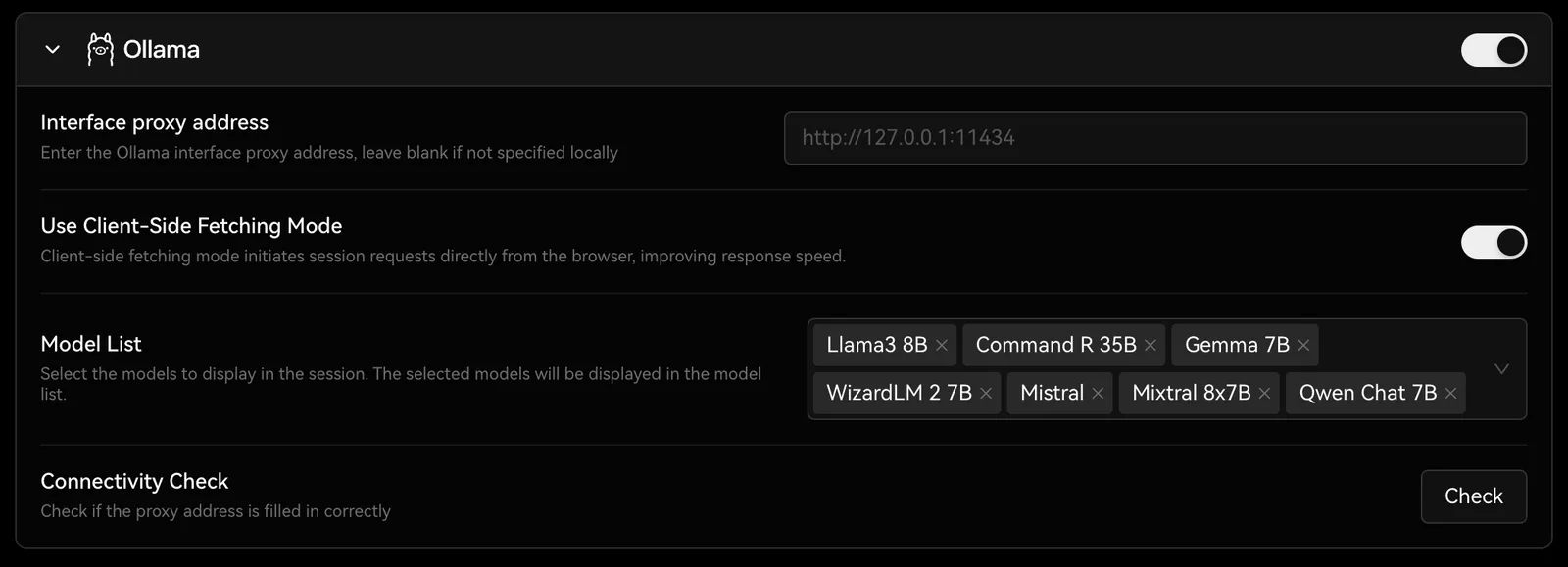

你可以在设置 -> 语言模型 中找到 Ollama 的配置选项,你可以在这里配置 Ollama 的代理、模型名称等。

你可以前往 与 Ollama 集成 了解如何部署 LobeVidol,以满足与 Ollama 的集成需求。